Zacznijmy od początku...

Uczenie maszynowe (Machine Learning, ML)

- poddziedzina AI, w której systemy uczą się na podstawie danych, bez konieczności programowania wszystkich reguł przez człowieka.

Cechy charakterystyczne:

- Model uczy się wzorców na podstawie przykładów (danych treningowych).

- Zdolność do generalizacji i predykcji wyników dla nowych danych.

Typowe zadania ML:

- klasyfikacja (np. nowotwór vs. zmiana łagodna),

- regresja (np. przewidywanie wartości ciśnienia tętniczego),

- klasteryzacja (np. grupowanie pacjentów według cech klinicznych).

Sieci neuronowe (Artificial Neural Networks)

Sieci neuronowe (Artificial Neural Networks, ANN)

– modele matematyczne inspirowane budową biologicznego mózgu, zdolne do przetwarzania informacji i wykrywania złożonych wzorców w danych.

Inspiracja biologiczna:

- Neurony → sztuczne jednostki obliczeniowe

- Synapsy → wagi (parametry modelu)

Zalety:

- wysokie możliwości predykcyjne,

- zdolność do pracy na danych nieliniowych i wielowymiarowych (np. obrazy, sygnały).

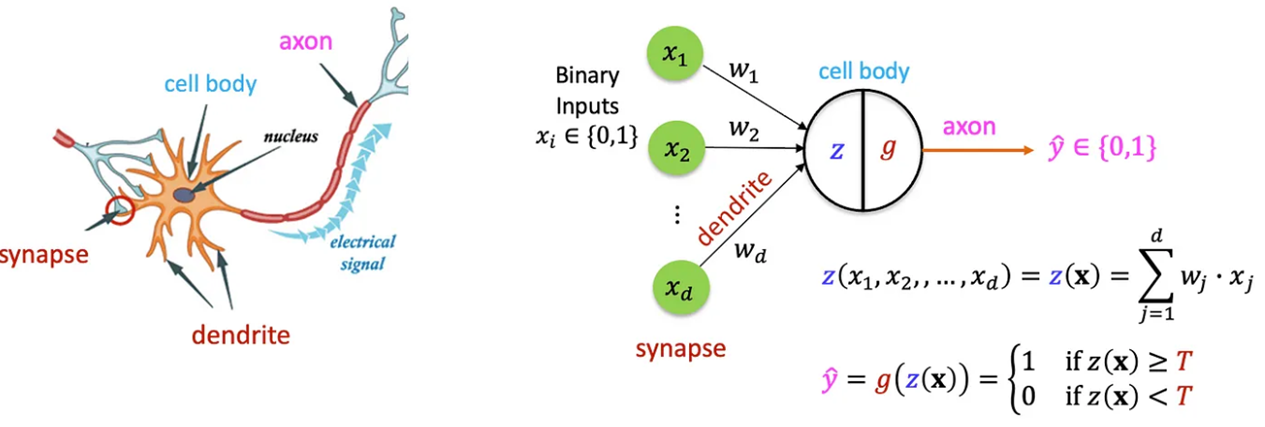

Czym jest sztuczny neuron?

Inspiracja biologiczna:

- Sztuczny neuron jest uproszczonym matematycznym modelem komórki nerwowej.

- Podobnie jak biologiczny neuron, odbiera sygnały, przetwarza je i generuje odpowiedź.

Elementy sztucznego neuronu:

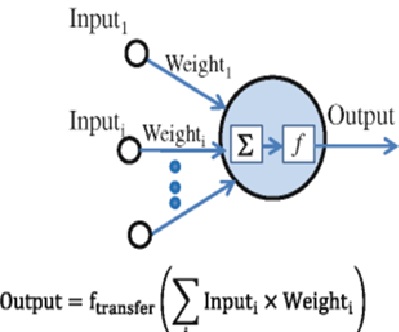

- Wejścia (inputy): sygnały wejściowe (np. dane pacjenta: wiek, wyniki badań)

- Wagi (weights): współczynniki określające znaczenie danego wejścia

- Funkcja aktywacji: decyduje, czy neuron "uaktywni się" (np. wyda diagnozę)

- Wyjście (output): wynik przetwarzania

Schemat działania:

-

Wejścia: x1,x2,...,xn

-

Wagi: w1,w2,...,wn

-

Suma ważona: z=w1x1+w2x2+...+wnxn+b (gdzie b to tzw. bias, czyli przesunięcie)

-

Funkcja aktywacji: y=f(z)

Przykładowe funkcje aktywacji:

-

Funkcja progowa (np. 0 lub 1)

-

ReLU (Rectified Linear Unit)

-

Sigmoid

-

Tangens hiperboliczny (tanh)

Intuicyjny opis: Neuron sumuje informacje, „ocenia ich wagę” i podejmuje decyzję – np. czy obraz sugeruje obecność zmiany nowotworowej.

Kluczowe pojęcia

- Dane treningowe – zestaw danych używanych do nauki modelu

- Model – matematyczna reprezentacja przetwarzająca dane wejściowe w wyniki

- Funkcja kosztu – mierzy, jak bardzo przewidywania odbiegają od rzeczywistych wyników

- Optymalizacja – proces dostosowywania modelu do danych (np. przez zmianę wag)

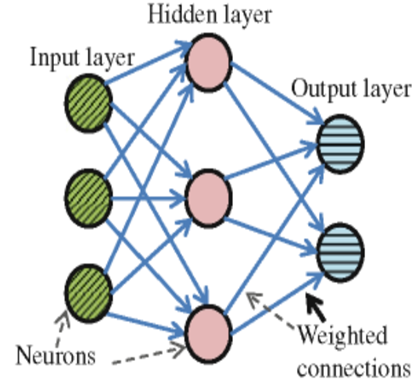

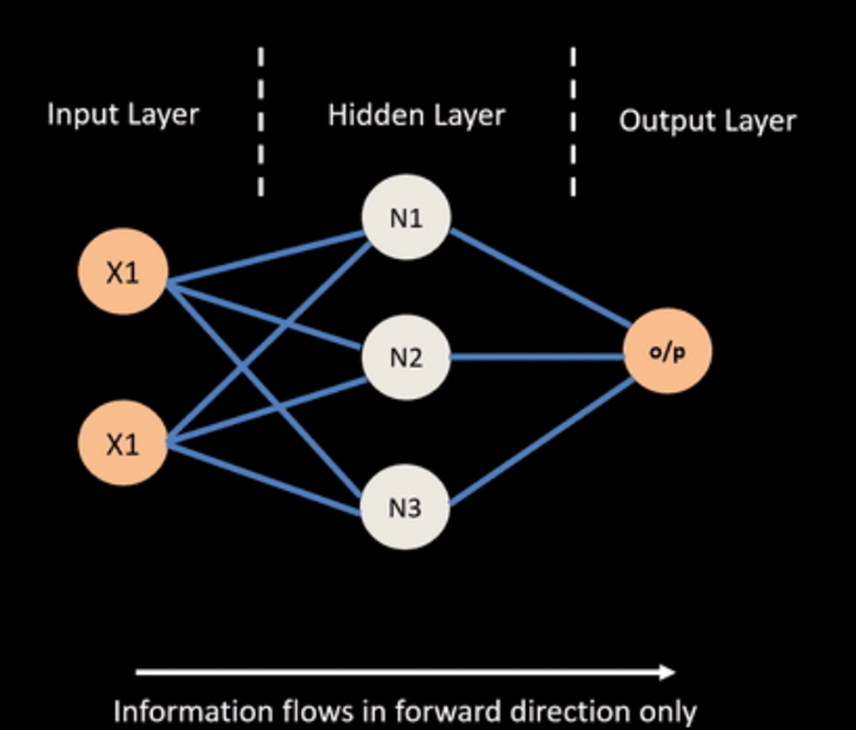

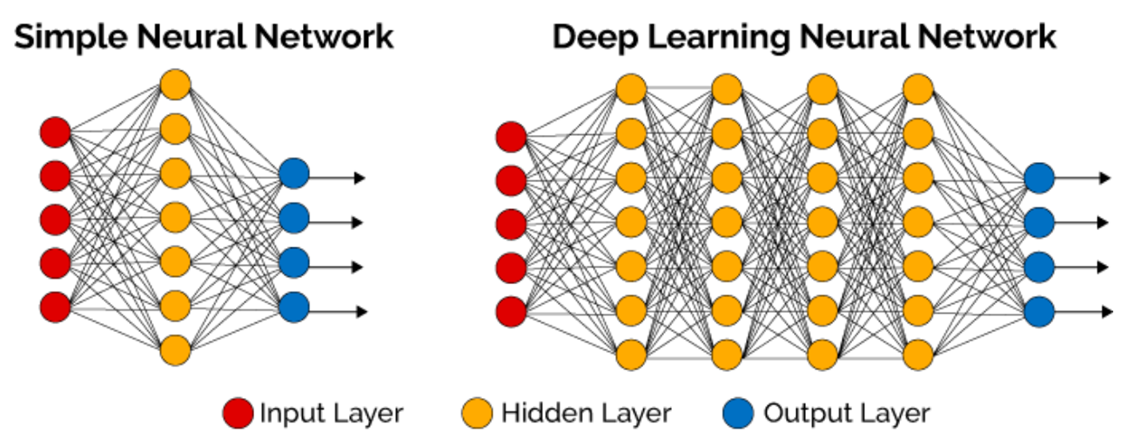

Budowa sieci neuronowej

- Sieć składa się z wielu połączonych neuronów ułożonych warstwowo:

- Warstwa wejściowa: odbiera dane (np. obraz, sygnał, liczby)

- Warstwy ukryte: przetwarzają dane na coraz wyższym poziomie abstrakcji

- Warstwa wyjściowa: zwraca ostateczny wynik (np. diagnoza: zdrowy/chory)

Przykład:

Sieć może analizować zdjęcie radiologiczne, wykrywać na nim cechy istotne klinicznie i klasyfikować je jako łagodne lub złośliwe.

Sieć składa się z wielu połączonych neuronów ułożonych warstwowo:

- Warstwa wejściowa: odbiera dane (np. obraz, sygnał, liczby)

- Warstwy ukryte: przetwarzają dane na coraz wyższym poziomie abstrakcji

- Warstwa wyjściowa: zwraca ostateczny wynik (np. diagnoza: zdrowy/chory)

Przykład:

Sieć może analizować zdjęcie radiologiczne, wykrywać na nim cechy istotne klinicznie i klasyfikować je jako łagodne lub złośliwe.

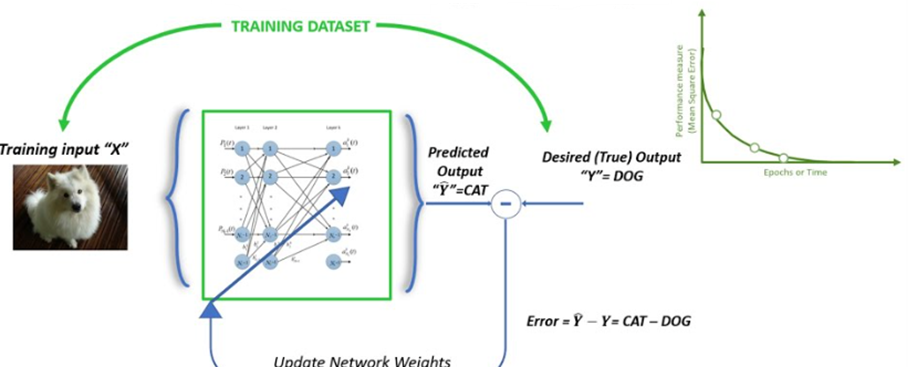

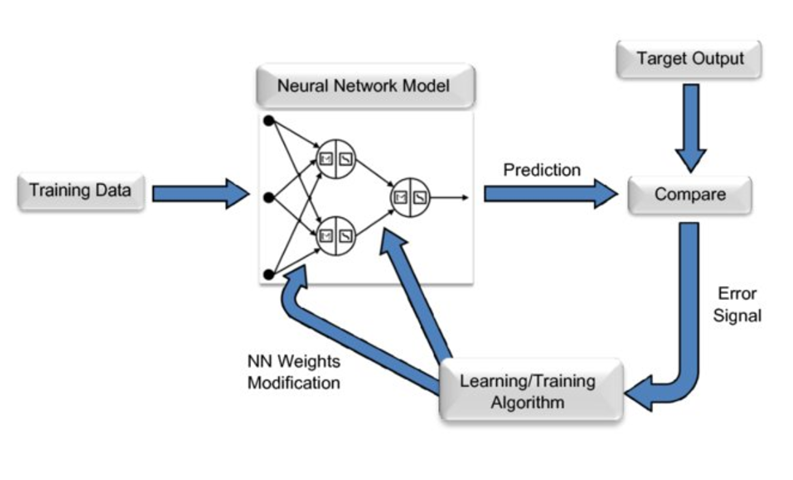

Proces uczenia się sieci neuronowej

Etapy:

- Uczenie na podstawie danych (trening):

- Sieć analizuje przykłady (np. obrazy + diagnozy) i uczy się rozpoznawać wzorce.

- Propagacja w przód:

- Dane wejściowe są przekazywane przez kolejne warstwy aż do uzyskania wyniku.

- Porównanie z prawdziwym wynikiem:

- Sieć oblicza błąd predykcji (różnica między wynikiem sieci a rzeczywistą diagnozą).

- Propagacja wsteczna (backpropagation):

- Sieć modyfikuje swoje wagi, by zmniejszyć błąd – „uczy się na błędach”.

Typy sieci neuronowych

Sieci neuronowe można klasyfikować według ich architektury oraz typu przetwarzanych danych. Dobór rodzaju sieci zależy od charakteru problemu oraz formatu danych (obrazy, tekst, sygnały biologiczne).

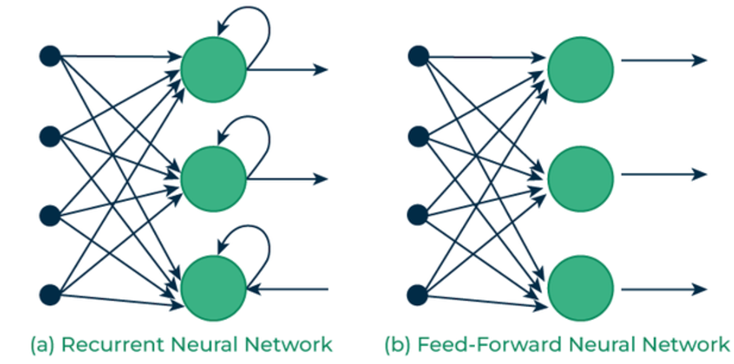

Sieci jednokierunkowe (Feedforward Neural Networks, FNN)

- Najprostszy typ sieci – dane przepływają od wejścia do wyjścia bez sprzężeń zwrotnych.

- Składają się z warstwy wejściowej, jednej lub wielu warstw ukrytych oraz warstwy wyjściowej.

Zastosowania:

- Klasyfikacja (np. rozpoznanie typu nowotworu)

- Regressja (np. prognozowanie poziomu glukozy)

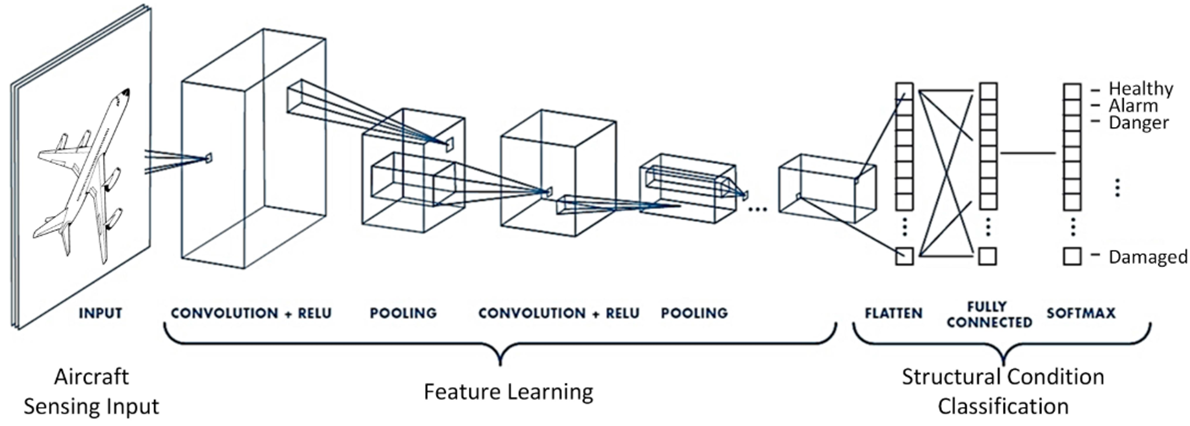

Sieci konwolucyjne (Convolutional Neural Networks, CNN)

- Sieci wyspecjalizowane w analizie danych obrazowych.

- Wykorzystują warstwy konwolucyjne do wykrywania wzorców i cech (np. krawędzie, kształty).

Zastosowania medyczne:

- Analiza zdjęć RTG, tomografii komputerowej (CT), rezonansu magnetycznego (MRI)

- Rozpoznawanie zmian nowotworowych, złamań, stanów zapalnych

- Diagnostyka skórna (np. czerniak)

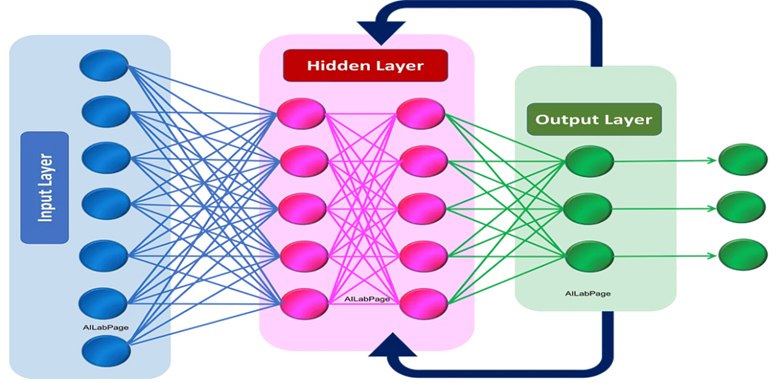

Sieci rekurencyjne (Recurrent Neural Networks, RNN)

- Sieci przetwarzające dane sekwencyjne (czasowe) z uwzględnieniem kontekstu poprzednich danych.

- Zawierają sprzężenia zwrotne – pamiętają poprzednie stany.

Zastosowania medyczne:

- Analiza sygnałów EKG, EEG

- Monitorowanie stanu pacjenta w czasie (np. na OIOM-ie)

- Przewidywanie zdarzeń klinicznych (np. ryzyko nagłego zatrzymania krążenia)

Sieci głębokie (Deep Neural Networks, DNN)

- Sieci o wielu warstwach ukrytych – umożliwiają modelowanie złożonych zależności.

- Wysoka moc obliczeniowa i zdolność do automatycznego wykrywania istotnych cech.

Zastosowania:

- Analiza dużych zbiorów danych pacjentów

- Wspomaganie decyzji klinicznych (CDSS)

- Przewidywanie odpowiedzi na leczenie

Porównanie typów sieci